DeepSeek-TUI新手入门指南:终端AI+本地模型调度

如果你最近看到“DeepSeek-TUI很火”,但不知道怎么用,可以先记住一个结论:DeepSeek-TUI本身不难用,难的是“本地模型部署”这一步。对于新手来说,最简单的方式不是手动配置环境,而是借助工具完成模型安装,再回到终端使用TUI。下面从趋势、问题到解决方案,一次讲清楚。

一、DeepSeek-TUI火起来的原因

从近期社区反馈来看,DeepSeek-TUI的走红并不是偶然,而是踩中了几个关键趋势:

1、终端AI成为开发者新入口

相比网页AI工具,TUI具备明显优势:

① 无需切换窗口(直接在开发环境使用)

② 可调用系统命令(更接近真实开发流程)

③ 支持自动执行任务(类似AI Agent)

换句话说,它不是“问答工具”,而是“执行工具”。

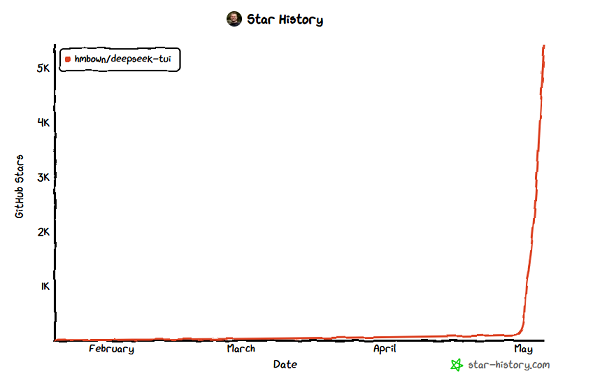

图源:GitHub

2、本地模型需求爆发

随着DeepSeek系列模型持续优化:

① 小模型(1.5B / 7B)已可在普通电脑运行

② 长上下文能力增强

③ 成本远低于云API

这使得越来越多人开始尝试:在本地运行AI,而不是完全依赖云端。

三、现实问题:大多数人卡在“不会部署”

虽然趋势很好,但很多用户在第一步就失败了:

常见问题 | 具体表现 |

|---|---|

不会装模型 | 不知道下载哪个版本 |

环境复杂 | Node、Python、依赖冲突 |

配置困难 | GPU / 内存不匹配 |

启动失败 | 路径、变量错误 |

这也是为什么很多人说:“DeepSeek很强,但我装不上。”

四、先把模型跑起来,再用DeepSeek-TUI

在这种背景下,一个很明显的变化是:越来越多用户不再手动折腾环境,而是选择“直接用工具部署模型”不是先研究TUI,而是先把模型跑起来。比如像OpenClaw部署助手这类工具,就属于这种思路:

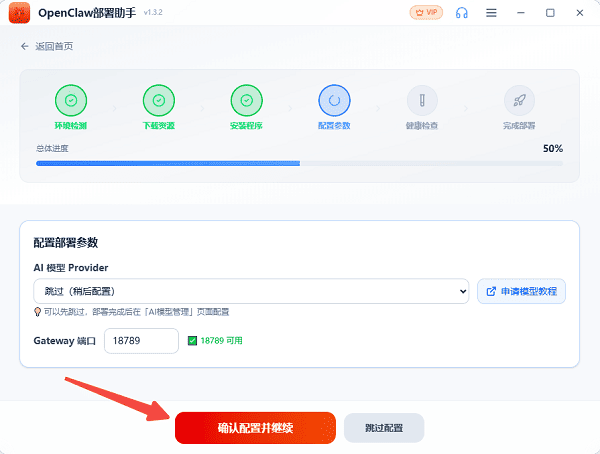

第一步:用工具部署模型

1、在电脑上安装并打开OpenClaw部署助手,点击“开始部署”,一键部署OpenClaw。

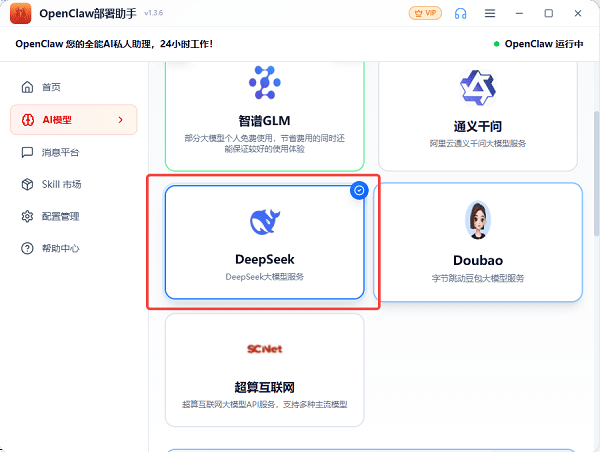

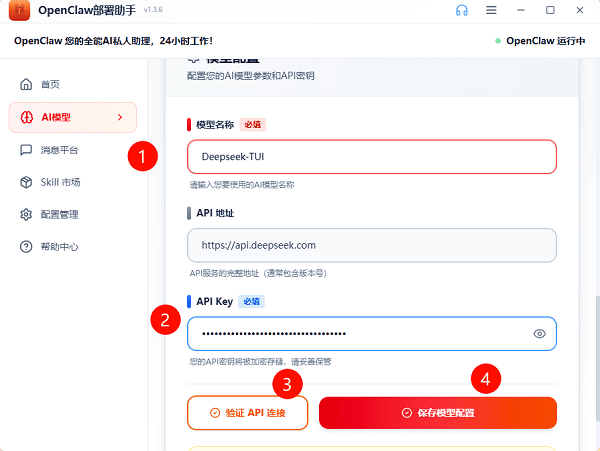

2、部署完成后我们就可以选择需要的DeepSeek模型,并根据提示输入API Key,完成模型的配置。

3、等待自动配置完成后,启动模型服务。

4、这一步完成后,你已经拥有一个“本地AI”。

第二步:再使用DeepSeek-TUI

1、此时再进入终端:deepseek-tui

2、就可以直接:

写代码

修改文件

执行命令

分析项目

3、整体体验会顺畅很多。

DeepSeek-TUI的火爆,说明AI正在进入更专业的使用场景。但对大多数人来说,真正的门槛并不在“会不会用”,而在“能不能跑起来”。如果你是新手,更推荐的路径是:先借助OpenClaw部署助手这类工具完成本地部署,再使用TUI进行操作。这样不仅效率更高,也更容易真正用上AI能力。